使用代理進行網絡爬蟲:實用指南

大規模網絡爬蟲需要代理以避免 IP 封鎖、維持匿名性,並在數以百萬計的請求中可靠地收集數據。以下是正確構建的方法。

大規模網絡爬蟲需要代理以避免 IP 封鎖、維持匿名性,並在數以百萬計的請求中可靠地收集數據。以下是正確構建的方法。

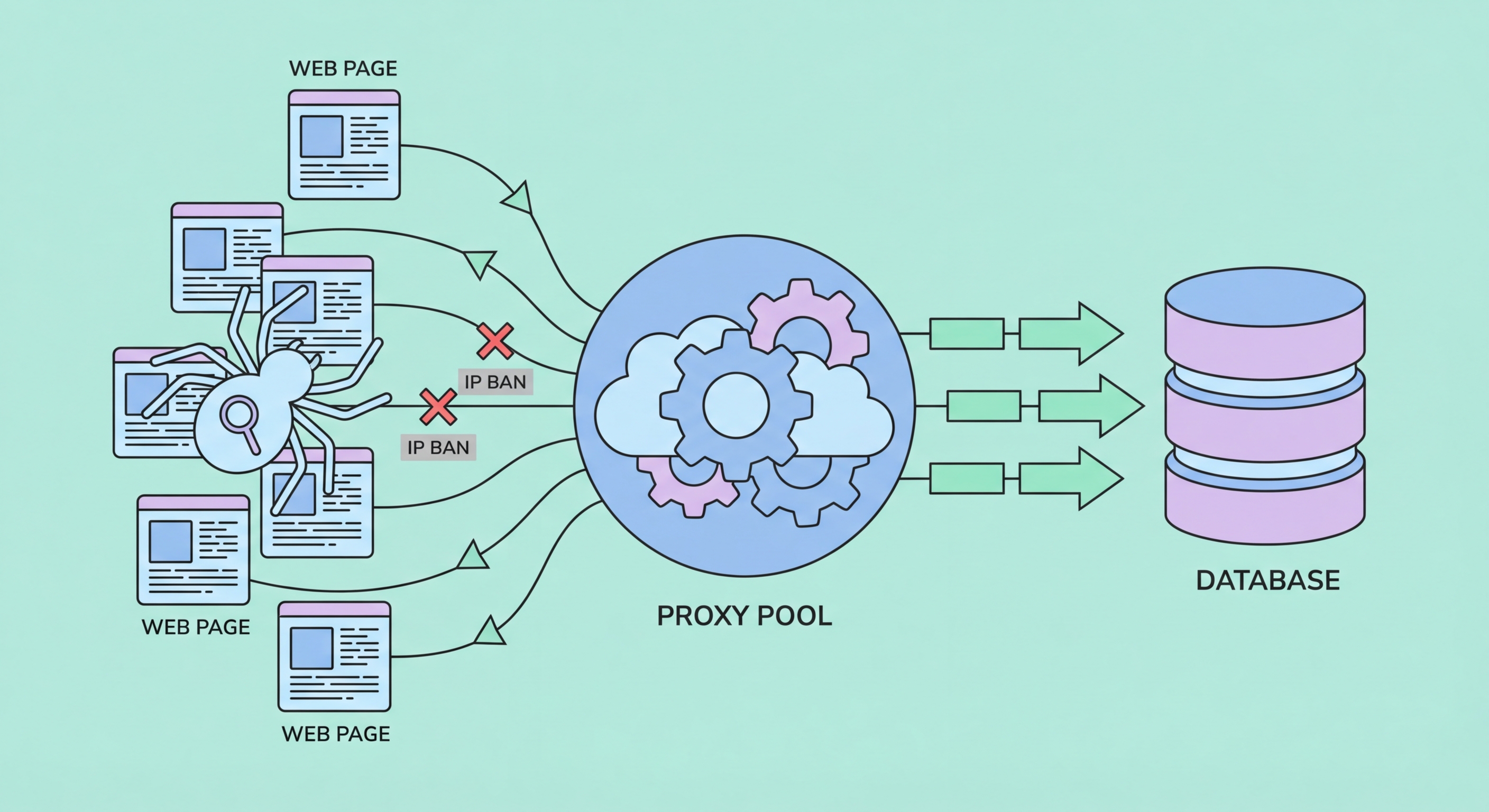

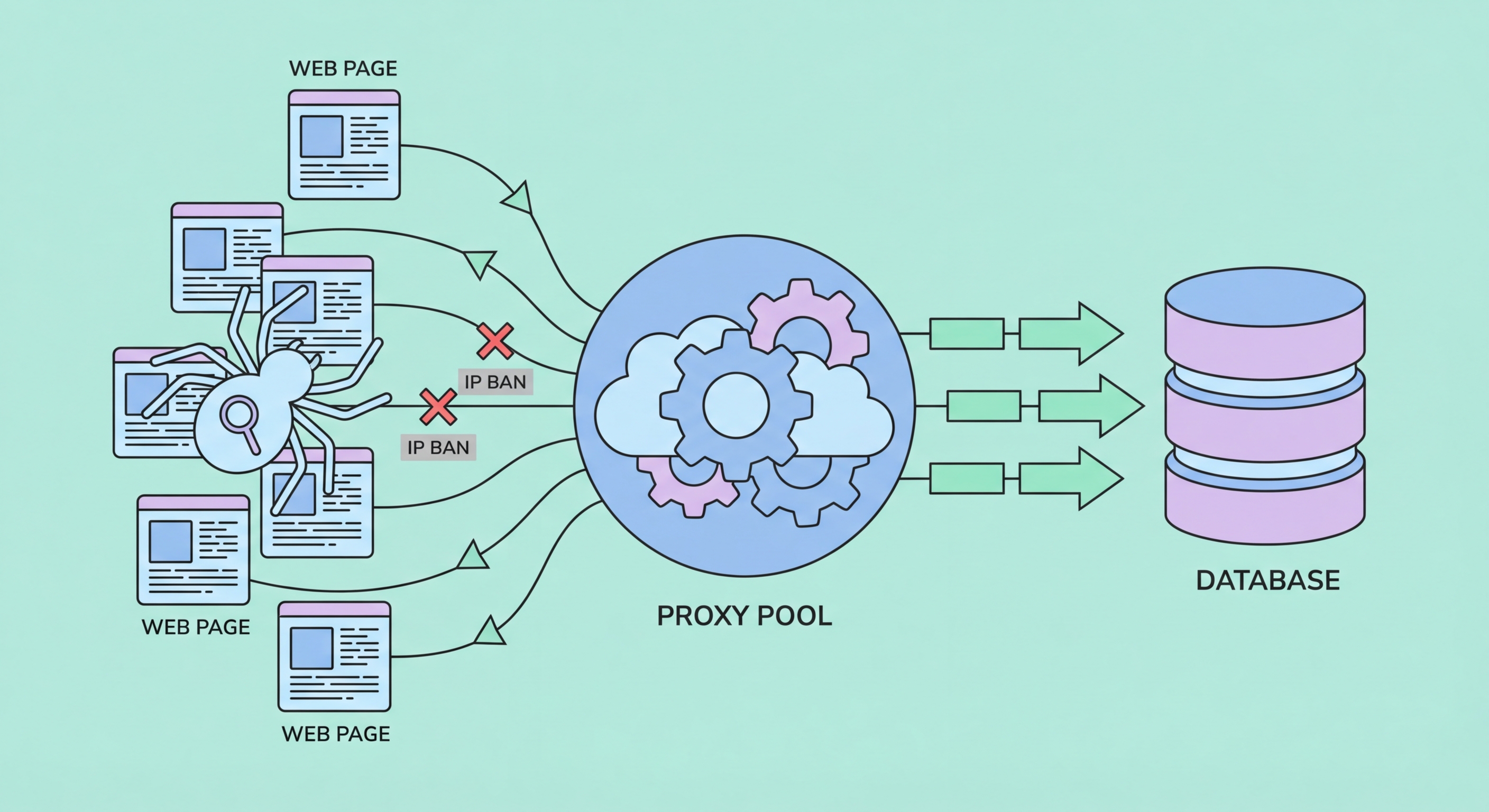

網絡爬蟲——從網站自動收集公開數據——在大規模運作時會遇到技術挑戰,因為網站會部署措施來偵測和封鎖自動化流量。最基本的防禦是基於 IP 的速率限制:追蹤每個 IP 位址發出的請求數量,並封鎖超過閾值的任何 IP。對於需要從電商網站收集 100 萬個產品列表的爬蟲任務,單一 IP 位址最多只能在幾百個請求後被封鎖,使得這項任務在沒有代理基礎設施的情況下根本無法完成。

若沒有代理,爬蟲完全可被識別:目標網站看到所有請求來自同一個 IP,而該 IP 屬於爬蟲操作者的 ISP ↗、雲端供應商或 VPN。使用代理後,請求分散在許多不同的 IP 位址上,使流量模式與許多獨立用戶同時訪問同一網站無法區分——這正是任何熱門網站在正常運作中在其伺服器上發生的情況。爬蟲的真實來源 IP 從不直接聯繫目標網站。

代理還能實現否則不可能完成的地理數據收集。電商平台經常向來自不同國家的用戶顯示不同的價格,以當地貨幣及當地稅務處理方式提供報價。搜尋引擎根據用戶的地理位置個性化結果,因此從不同城市查看搜尋排名需要使用真正位於這些城市的 IP。若沒有帶有真實本地 IP 位址的住宅代理,收集到的數據將是平台預設的國際視圖,而非地理上準確的本地體驗。

生產級網絡爬蟲技術棧涉及多個協同工作的組件:請求排程器、代理管理器、解析器、儲存後端及錯誤處理邏輯。代理管理器負責為每個請求選擇使用哪個 IP、追蹤哪些 IP 最近被使用或已失敗,以及在需要時管理固定工作階段。許多團隊使用開源框架,如 Scrapy(Python)或 Crawlee(Node.js),這些框架透過中介軟體和外掛程式內建代理輪換支援。

請求標頭與代理設定同樣重要,對於避免偵測至關重要。瀏覽器訪問網站時會發送數十個標頭:User-Agent、Accept、Accept-Language、Accept-Encoding、Referer、Sec-Fetch 標頭等。簡陋的爬蟲僅發送 URL 而無標頭,或使用明顯非瀏覽器的 User-Agent(如 Python-requests/2.28.0),無論如何輪換代理都會被識別和封鎖。您的爬蟲應發送與所使用 User-Agent 字串相符的真實瀏覽器標頭。輪換多個不同的 User-Agent 字串(代表不同瀏覽器版本和作業系統)可進一步減少指紋識別。

請求時序是避免偵測的第三個支柱。真實的人瀏覽網站時,頁面加載之間會花費不同的時間——閱讀內容、捲動頁面、思考選項。以精確的 2 秒間隔或以最高速度發送請求的機器人立即可被識別。在請求之間實施從真實分布中抽取的隨機延遲(例如,2 至 8 秒之間的均勻隨機,偶爾更長)。在信息密度高的頁面後增加額外的思考時間。模仿人類瀏覽的時序模式,而非純粹優化速度——額外的時間成本通常遠小於在被封鎖請求上浪費的代理頻寬成本。

網絡爬蟲涉及複雜的法律環境,因司法管轄區及所收集的具體數據而異。在香港,為合法商業目的收集公開可存取的網絡數據通常是合法的。《個人資料(私隱)條例》(PDPO)是需要考量的關鍵法規:若您正在爬取個人資料——姓名、電郵地址、電話號碼,或任何可識別個人的資訊——您必須遵守 PDPO 關於收集目的、使用限制及資料保留的要求。收集不識別個人的公開商業資訊或定價數據通常不在 PDPO 範疇之內。

網站服務條款(ToS)通常禁止自動爬蟲。雖然違反網站服務條款通常是您與網站運營者之間的民事事宜,而非刑事罪行,但可能導致您的存取被終止,並可能引發民事法律行動。服務條款禁止爬蟲的法律狀況在國際法院中一直存在爭議——美國案例(包括 hiQ Labs 對 LinkedIn)通常認定爬取公開可存取的數據受到保護,但這並非普遍確立的法律。對於大規模的商業運作,諮詢熟悉您的業務司法管轄區及您爬取的網站所在司法管轄區的律師是明智之舉。

道德考量超出了法律合規的範疇。即使爬蟲是合法的,激進的爬蟲也可能通過消耗伺服器資源而降低網站對合法用戶的性能。最佳實踐包括:遵守 robots.txt 指令(example.com/robots.txt 的文件,指定爬蟲可以存取哪些頁面)、將請求速率限制在不影響網站性能的水平、盡可能在非高峰時段進行爬蟲,以及在可能的情況下主動聯繫網站尋求數據存取合作或官方 API。許多公司願意為直接聯繫他們的合法商業用戶提供結構化的數據存取。

對於網絡爬蟲使用情境,代理供應商的選擇標準與一般代理需求略有不同。最重要的因素是池大小(較大的池支援更多並行爬蟲並減少 IP 重用頻率)、地理覆蓋範圍(針對特定國家或城市需要這些地點的真實 IP)、API 品質(良好的文檔、可靠的性能及程式化工作階段管理對生產系統至關重要),以及與您使用模式一致的定價模式。

幾家代理供應商已針對爬蟲使用情境開發了超越原始代理供應的專用產品。Bright Data 的 Web Unlocker 和 Smartproxy 的 Site Unblocker 等服務是托管爬蟲 API,可自動處理代理輪換、驗證碼解決、瀏覽器指紋管理及 JavaScript 渲染——您發送一個 URL,它們返回已渲染的 HTML。這些托管服務每個請求的成本高於原始代理,但對於不想自己構建和維護完整爬蟲技術棧的團隊來說,可顯著降低工程複雜性。

對於構建內部爬蟲基礎設施的團隊,Bright Data、Oxylabs、Smartproxy 和 IPRoyal 是在爬蟲工作負載方面擁有成熟記錄的最知名供應商。透過在您的實際目標網站上進行試用來評估它們——成功率因目標而異,沒有任何供應商能在未針對您的具體目標進行測試的情況下保證結果。尋找提供按需付費定價進行初始測試的供應商(以便在承諾大型訂閱前進行評估),以及為整合問題提供積極技術支援的供應商。